Revisamos los planes de gobiernos de los cinco partidos que…

Del 23 al 25 de julio de 2025, la presidenta de ACCESA, Daniela Chacón Mendoza, participó en el Peer Learning Circle “South to South”, organizado por el Pulitzer Center con el apoyo del Leverhulme Centre for the Future of Intelligence de la Universidad de Cambridge. Este espacio reunió a periodistas, investigadoras y representantes de la sociedad civil del Sur Global para reflexionar sobre los riesgos, desafíos y oportunidades que plantea la inteligencia artificial (IA).

Un espacio de aprendizaje colaborativo

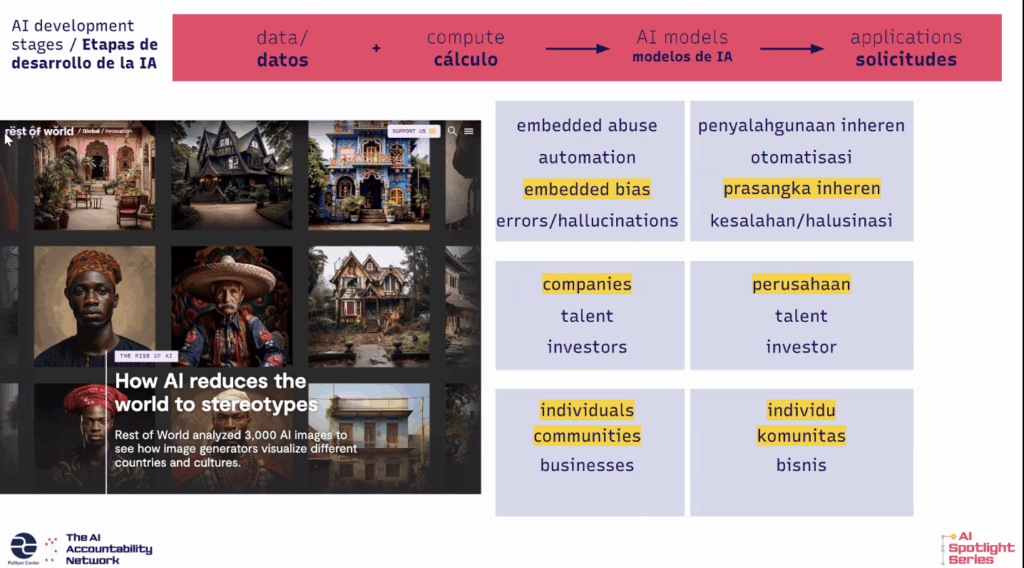

El taller se desarrolló durante tres días e incluyó sesiones teóricas, análisis de casos y actividades prácticas. Bajo la guía de Maya Indira Ganesh y Tomasz Hollanek, se abordaron:

- Los fundamentos históricos y técnicos de la IA, incluyendo el auge de la IA generativa y sus implicaciones sociales.

- Un marco para la rendición de cuentas en IA, que permite identificar en cada etapa del ciclo de vida de la IA (datos, modelos, cómputo y aplicaciones) a los actores involucrados, los problemas asociados y las poblaciones impactadas.

- Casos reales de investigación periodística sobre sistemas de IA, como el uso de reconocimiento facial en Buenos Aires, los sesgos en la verificación biométrica de Uber en India y los impactos ambientales del crecimiento acelerado de centros de datos en Malasia.

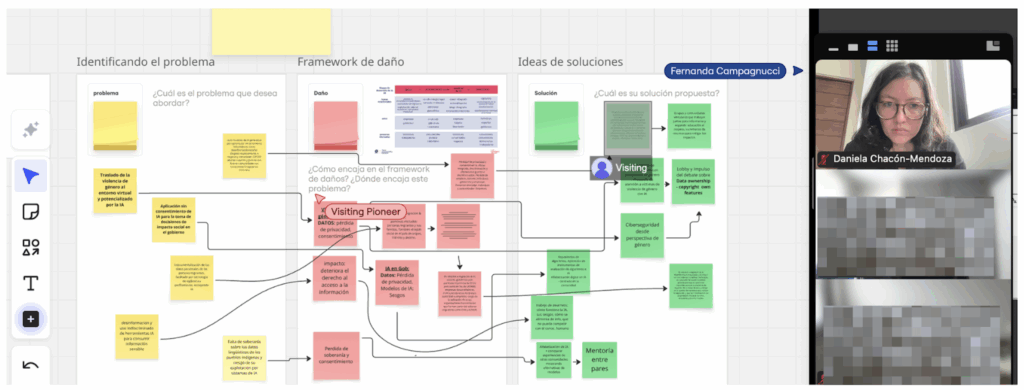

Harms framework y ejercicios prácticos

Uno de los aportes centrales fue el marco de daños (harm framework), que ayudó a mapear riesgos como:

- Explotación laboral y pérdida de privacidad.

- Capitalismo de vigilancia y erosión de derechos fundamentales.

- Sesgos integrados y errores sistémicos en los modelos.

- Impactos ambientales y geopolíticos del entrenamiento de IA.

A partir de este marco, los grupos regionales realizaron ejercicios en tableros colaborativos para identificar daños concretos en sus contextos y proponer soluciones. En el grupo de América Latina se discutieron ejemplos vinculados a la explotación de niñas, niños y adolescentes en entornos digitales, así como a la expansión de la vigilancia masiva en la región.

Gobernanza de la IA: el rol de la sociedad civil

El segundo día se centró en los mecanismos de gobernanza de la IA a nivel global, nacional y corporativo. Se revisaron:

- Instrumentos de hard law, como el AI Act de la Unión Europea.

- Marcos de soft law internacionales, como la metodología de la UNESCO para evaluar la preparación de los países en IA.

- Estrategias de autorregulación corporativa, como las model cards y datasheets de modelos de IA.

Se destacó el papel de la sociedad civil en:

- Documentar incidentes y daños.

- Exigir transparencia y auditorías independientes.

- Representar a comunidades afectadas en procesos regulatorios.

- Crear narrativas alternativas y enfoques inclusivos.

Conexiones desde América Latina

La participación de ACCESA permitió compartir la experiencia de la región en temas como:

- Transparencia algorítmica y creación de repositorios de algoritmos públicos.

- Protección de derechos digitales frente a la vigilancia y la desinformación.

- Inclusión de la perspectiva de género en la evaluación de tecnologías emergentes.

El Peer Learning Circle “South to South” evidenció que los desafíos de la IA son globales, pero que las soluciones deben construirse desde realidades locales, con la sociedad civil como actor clave para garantizar una IA ética, inclusiva y responsable.